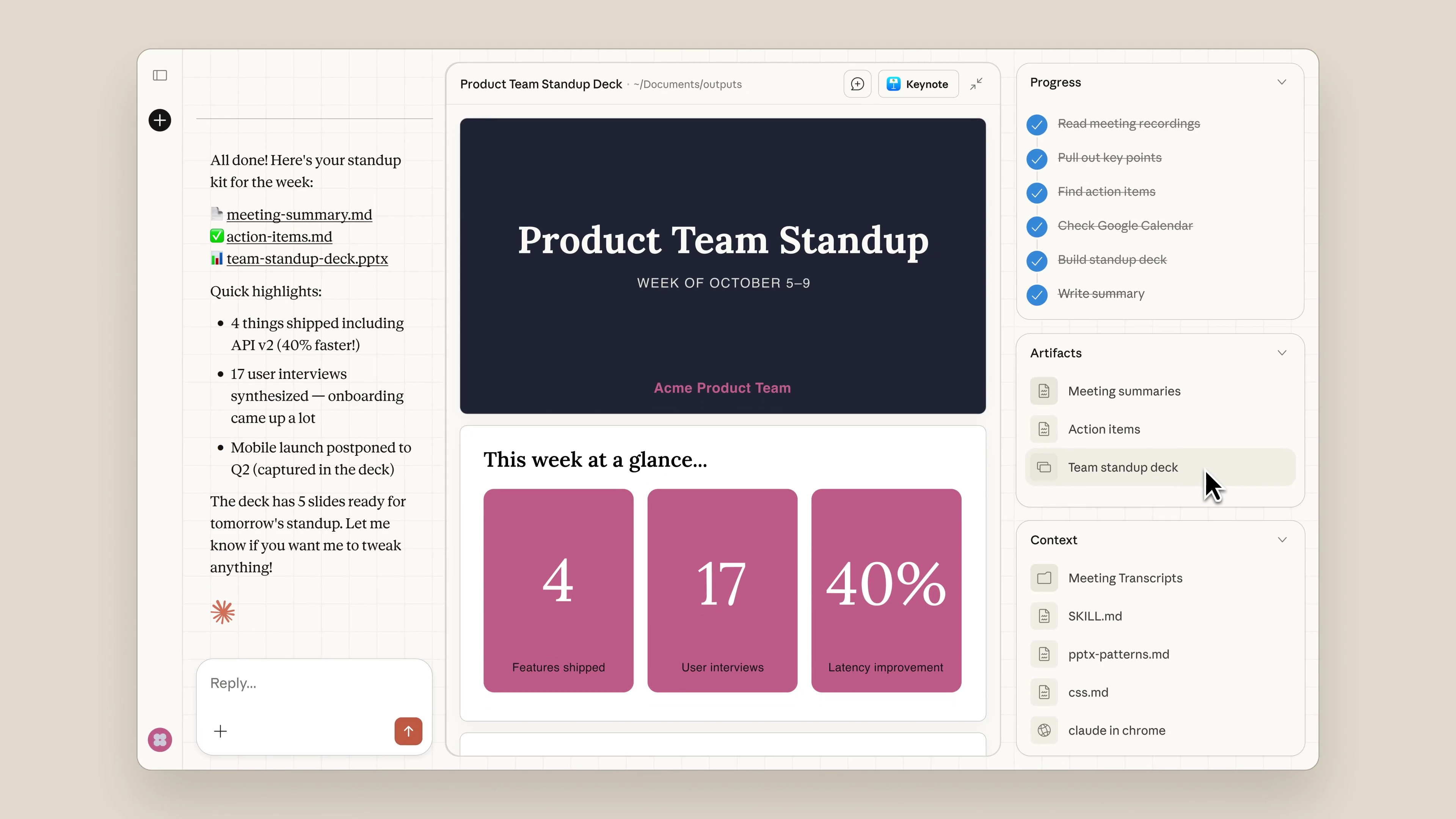

Le lancement de Claude Cowork représente plus qu'un simple outil AI — il signale un changement fondamental vers la démocratisation de la collaboration AI. Dans cet article, nous explorons le concept d'"Open Cowork" et comment il redéfinit l'avenir de la productivité alimentée par l'AI.

La philosophie d'Open Cowork

"Open Cowork" représente un paradigme où les outils de collaboration AI sont :

- Accessibles à tous, quel que soit le niveau technique

- Transparents dans leur fonctionnement et le traitement des données

- Interopérables avec les flux de travail et outils existants

- Personnalisables selon les besoins individuels et d'équipe

Claude Cowork incarne bon nombre de ces principes en apportant de puissantes capacités AI aux non-développeurs. Mais la véritable vision d'Open Cowork va au-delà de tout produit unique — il s'agit de construire un écosystème ouvert où les assistants AI peuvent s'intégrer de manière transparente dans notre façon de travailler.

De Claude Code aux alternatives ouvertes

L'évolution

Le parcours a commencé avec Claude Code, un outil basé sur le terminal pour les développeurs. Il a été intentionnellement conçu pour être :

"Bas niveau et sans opinion, fournissant un accès presque brut au modèle sans imposer de flux de travail spécifiques."

Cette philosophie a créé un outil puissant flexible, personnalisable, scriptable et sûr que les développeurs ont adoré. Maintenant, avec Cowork, cette puissance s'étend à tous.

Le mouvement open source

Le succès de Claude Code a déclenché une révolution open source. Les développeurs voulaient des capacités similaires sans verrouillage fournisseur ni coûts d'abonnement. Cela a conduit à plusieurs projets remarquables :

| Outil | Étoiles | Description | Idéal pour |

|---|---|---|---|

| OpenCode | 60,000+ | Alternative à Claude Code agnostique du fournisseur | Flexibilité auto-hébergée |

| Cline | 4M+ installations | Agent de codage AI autonome pour IDE | Utilisateurs VS Code/JetBrains |

| Aider | 25,000+ | Programmeur en binôme terminal conscient de Git | Développeurs axés sur le terminal |

| Goose CLI | 15,000+ | Assistant AI entièrement local | Axé sur hors ligne/confidentialité |

| OpenHands | 50,000+ | Agents de développement autonomes | Tâches complexes multi-étapes |

Plongée profonde : OpenCode - L'alternative ouverte

OpenCode mérite une attention particulière en tant qu'équivalent open source le plus direct de Claude Code.

Avantages clés

1. Agnostique du fournisseur

Prend en charge plus de 75 fournisseurs AI :

- OpenAI (GPT-4, o1)

- Anthropic (Claude)

- Google (Gemini)

- Modèles locaux (Ollama, LM Studio)

- Modèles open source (Llama, Qwen, GLM)2. Efficacité des coûts

| Fournisseur | Coût par million de tokens | Économies vs Claude |

|---|---|---|

| Claude Sonnet 4.5 | $3-15 | Référence |

| GLM-4.7 | $0.088 | 97% d'économies |

| Qwen-Max | $0.40 | 87% d'économies |

| Devstral 2 | $1.20 | 60% d'économies |

3. Architecture avancée

OpenCode utilise une conception client/serveur permettant :

- Espaces de travail Docker distants persistants

- Sessions d'édition collaborative

- Intégrations d'outils personnalisés

- Déploiements isolés

Comparaison des performances

Dans des tests directs avec des tâches identiques :

| Tâche | Claude Code | OpenCode |

|---|---|---|

| Refactorisation inter-fichiers | 3 min | 3 min |

| Corrections de bugs | 40 sec | 40 sec |

| Génération de tests | 73 tests | 94 tests |

| Temps total | 9m 9s | 16m 20s |

Verdict : Claude Code privilégie la vitesse ; OpenCode met l'accent sur la minutie et la flexibilité.

Construire votre stack Open Cowork

Option 1 : Pur open source

Pour un contrôle maximal et aucun verrouillage fournisseur :

Composants de la stack :

├── Fournisseur AI : Ollama + Llama 3.2

├── Agent de codage : OpenCode ou Cline

├── Gestion de fichiers : Scripts personnalisés

├── Intégration : MCP open source

└── Coût : $0 (calcul uniquement)Avantages : Contrôle total, confidentialité, pas de coûts récurrents Inconvénients : Nécessite une configuration technique, peut manquer certaines fonctionnalités

Option 2 : Approche hybride

Équilibrer coût, capacité et commodité :

Composants de la stack :

├── Fournisseur AI : OpenRouter (multi-modèle)

├── Agent de codage : Cline (VS Code)

├── Tâches générales : Claude Cowork (si nécessaire)

├── Intégration : Mélange d'open et commercial

└── Coût : ~$20-50/moisAvantages : Flexibilité, meilleur de sa catégorie pour différentes tâches Inconvénients : Plusieurs outils à gérer

Option 3 : Open Cowork d'entreprise

Pour les équipes nécessitant gouvernance et échelle :

Composants de la stack :

├── Fournisseur AI : Azure OpenAI ou AWS Bedrock

├── Agent de codage : OpenHands (auto-hébergé)

├── Orchestration : Flux de travail personnalisés

├── Sécurité : Contrôles d'entreprise

└── Coût : Basé sur l'utilisation + infrastructureAvantages : Sécurité, conformité, évolutivité Inconvénients : Complexité de mise en œuvre

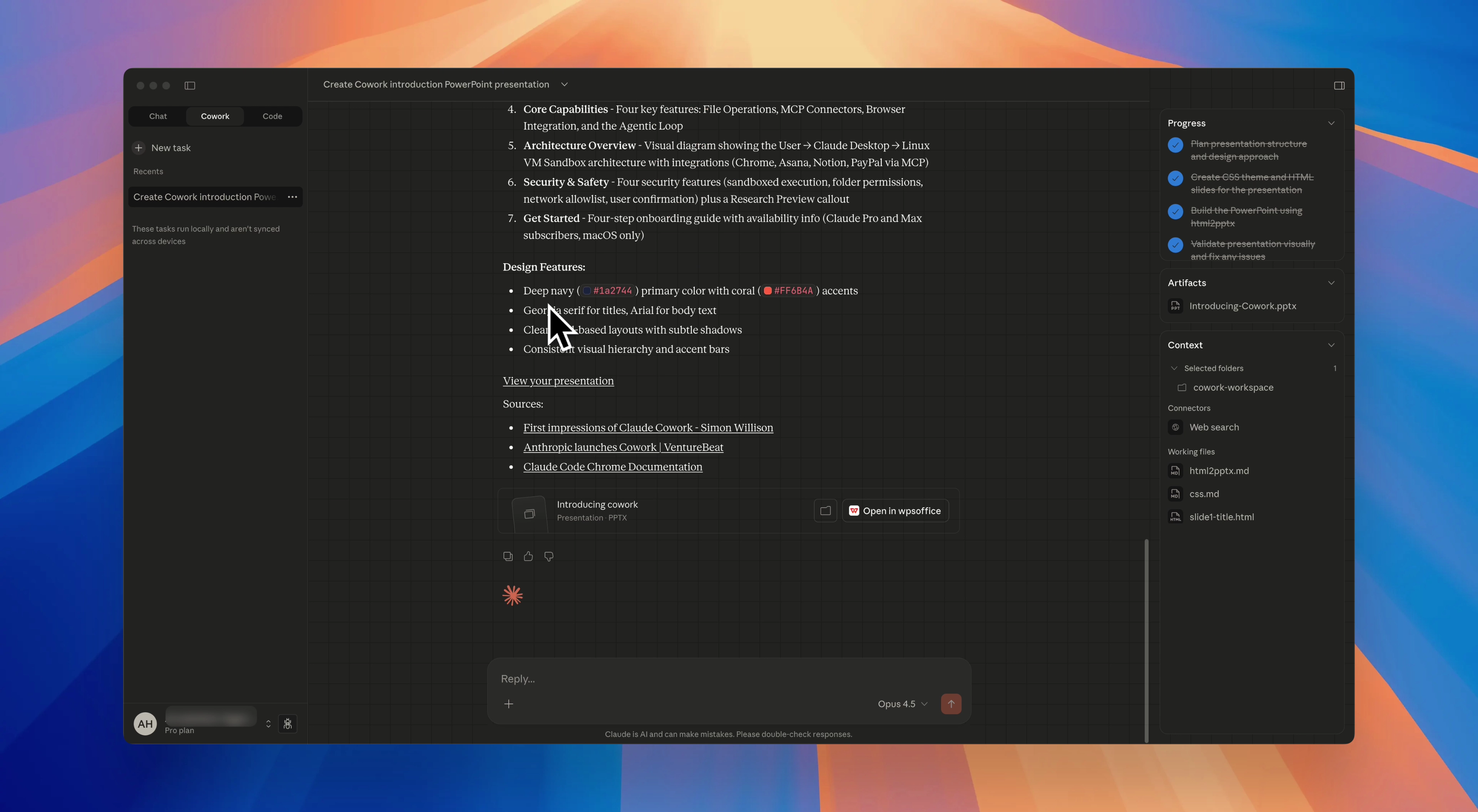

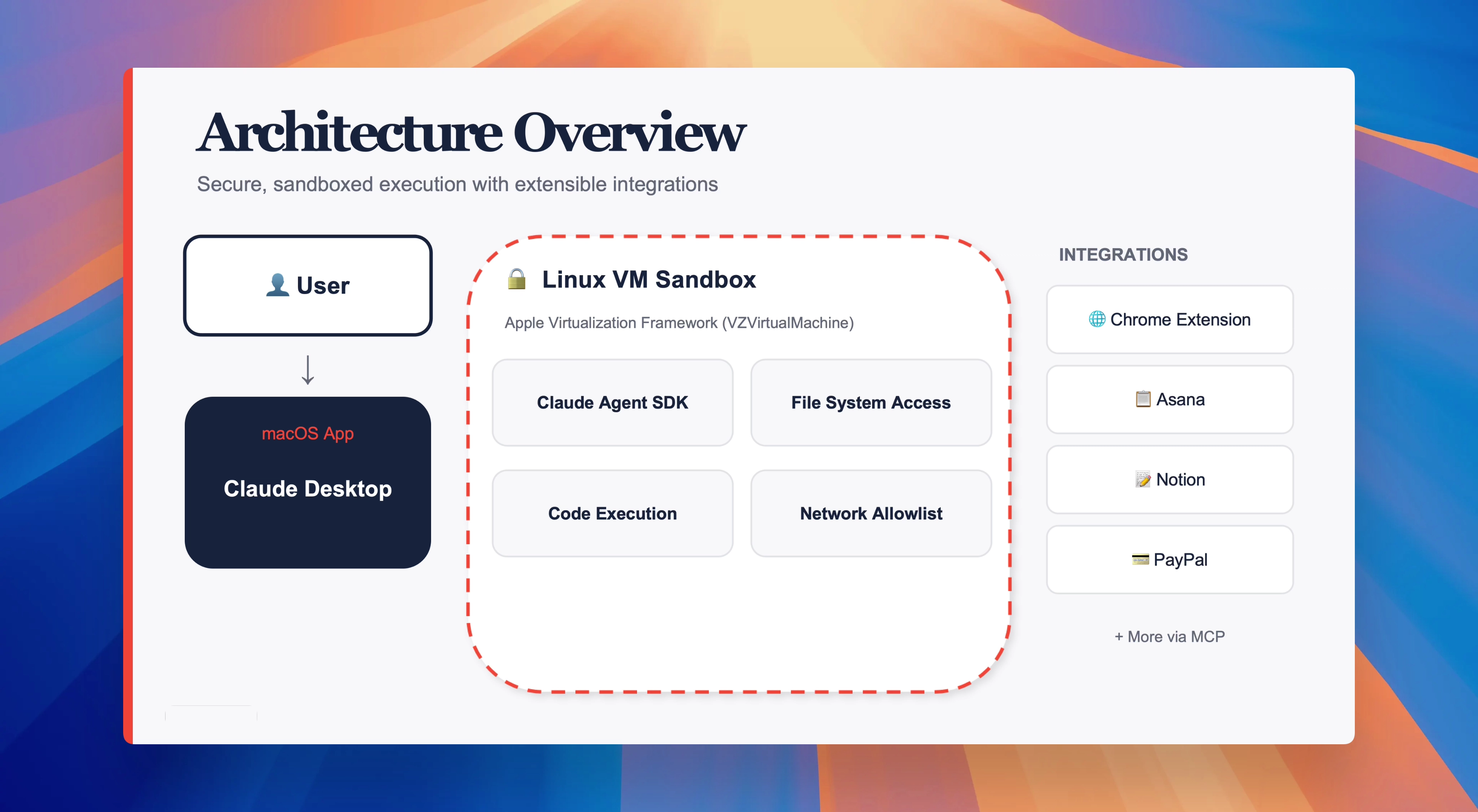

La révolution MCP : Véritable ouverture

L'un des développements les plus significatifs du mouvement Open Cowork est le Model Context Protocol (MCP).

Qu'est-ce que MCP ?

MCP est une norme pour connecter les outils AI aux services externes :

Agent AI ←→ Protocole MCP ←→ Services externes

Exemples :

- Claude ←→ MCP ←→ Google Drive

- OpenCode ←→ MCP ←→ GitHub

- Cline ←→ MCP ←→ Bases de donnéesPourquoi MCP est important

- Interopérabilité : Tout outil compatible MCP peut utiliser tout service compatible MCP

- Extensibilité : Les développeurs peuvent créer des MCP personnalisés pour n'importe quel service

- Portabilité : Changez d'outils AI sans perdre les intégrations

MCP populaires

| MCP | Fonction | Compatible avec |

|---|---|---|

| filesystem | Accès aux fichiers locaux | Tous les agents majeurs |

| github | Gestion de dépôts | Claude Code, OpenCode |

| slack | Communication d'équipe | Cowork, Cline |

| browser | Navigation web | Claude, OpenHands |

| database | Accès SQL/NoSQL | OpenCode, Aider |

Créer votre propre environnement Open Cowork

Étape 1 : Choisissez votre backend AI

Pour les utilisateurs soucieux du budget :

- Local : Ollama + Codestral

- API : OpenRouter avec limites de coût

Pour les utilisateurs axés sur la qualité :

- API Claude avec outils personnalisés

- GPT-4o pour des tâches spécifiques

Pour les utilisateurs axés sur la confidentialité :

- Entièrement local avec Llama 3.2

- Déploiement isolé

Étape 2 : Configurez votre agent

Utilisateurs de terminal :

# Installer OpenCode

npm install -g opencode

# Configurer le fournisseur

opencode config set provider ollama

opencode config set model codestral:latest

# Commencer à travailler

opencode "Refactoriser le module d'authentification"Utilisateurs d'IDE :

- Installer l'extension Cline

- Configurer votre fournisseur AI préféré

- Activer les intégrations MCP

- Commencer à coder avec l'assistance AI

Étape 3 : Intégrer avec votre flux de travail

Créez des flux de travail personnalisés combinant plusieurs outils :

# workflow.yaml

name: "Génération de rapport hebdomadaire"

steps:

- agent: opencode

task: "Analyser les commits git de la semaine dernière"

- agent: cowork

task: "Rechercher les mises à jour des concurrents"

- action: combine

output: "weekly-report.md"L'avenir d'Open Cowork

Tendances émergentes

1. Collaboration multi-agents Des agents AI travaillant ensemble, chacun spécialisé dans différentes tâches :

- L'agent de recherche collecte des informations

- L'agent d'analyse traite les données

- L'agent de rédaction crée des rapports

- L'agent de révision vérifie la qualité

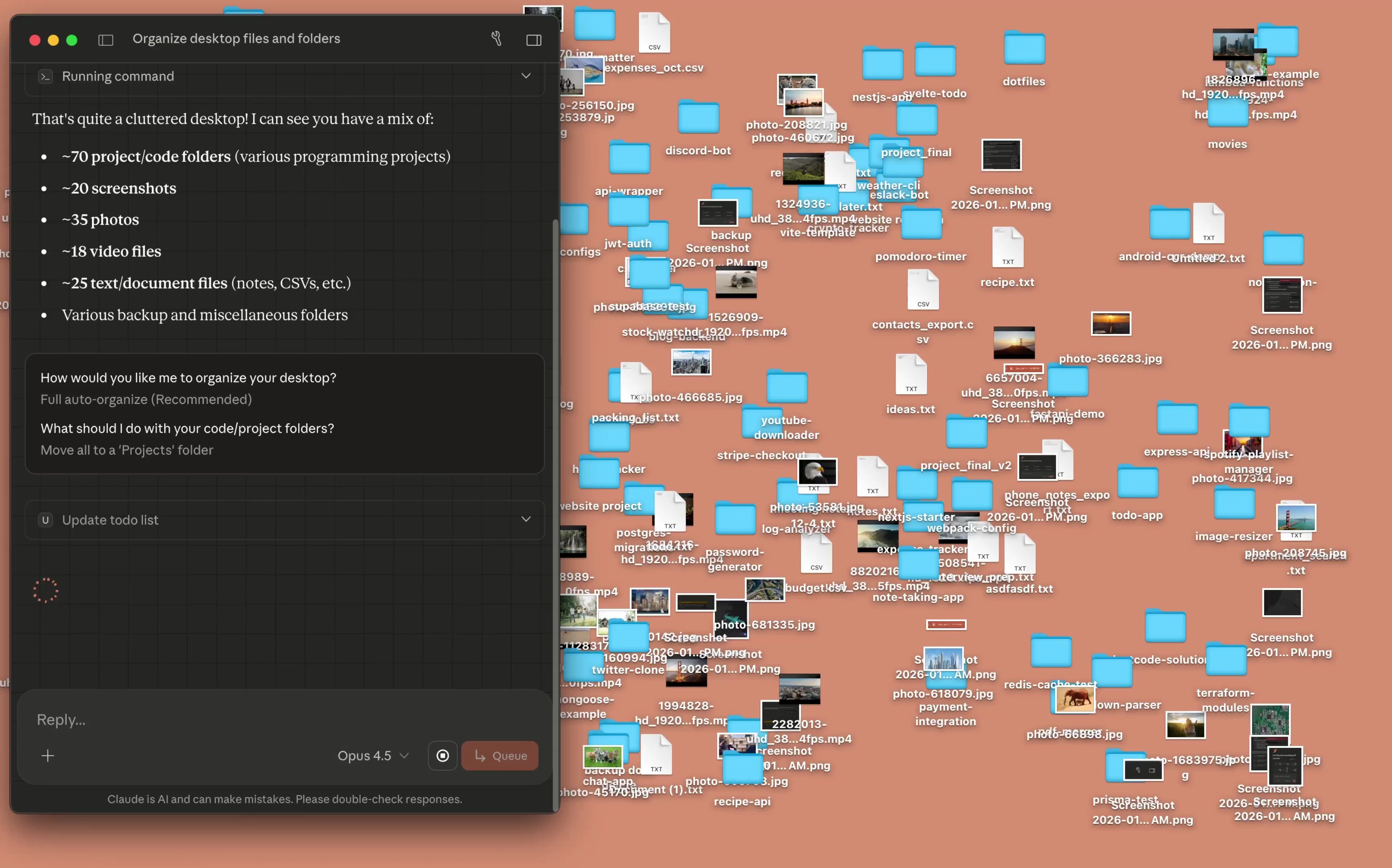

2. Espaces de travail AI personnels Votre propre environnement AI qui :

- Apprend vos préférences au fil du temps

- Maintient le contexte entre les sessions

- S'intègre avec tous vos outils

- Fonctionne localement pour la confidentialité

3. Réseaux AI fédérés Systèmes AI distribués où :

- Les modèles fonctionnent sur plusieurs nœuds

- Pas de point de défaillance unique

- Confidentialité préservée par chiffrement

- Coûts partagés entre les utilisateurs

Ce que cela signifie pour vous

Le mouvement Open Cowork vous donne des choix :

- Utilisez Claude Cowork pour des expériences fluides et polies

- Utilisez des alternatives open source pour le contrôle et les économies de coûts

- Mélangez et associez les outils pour des résultats optimaux

- Construisez des solutions personnalisées sur des fondations ouvertes

Passer à l'action

Pour les particuliers

- Commencez avec Claude Cowork pour comprendre le paradigme

- Expérimentez avec OpenCode ou Cline pour les tâches techniques

- Explorez les intégrations MCP pour étendre les capacités

- Rejoignez les communautés pour apprendre et contribuer

Pour les équipes

- Évaluez les exigences de sécurité pour la sélection d'outils AI

- Pilotez plusieurs outils pour trouver le meilleur ajustement

- Développez des directives internes pour la collaboration AI

- Formez les membres de l'équipe à l'utilisation efficace de l'AI

Pour les développeurs

- Contribuez aux projets open source comme OpenCode ou Cline

- Construisez des MCP pour les services que vous utilisez

- Partagez des flux de travail que d'autres peuvent adapter

- Documentez les meilleures pratiques pour la communauté

Conclusion

Claude Cowork n'est pas qu'un produit — c'est une partie d'un mouvement plus large vers Open Cowork, où les outils de collaboration AI sont accessibles, transparents et interopérables. Que vous choisissiez la solution polie d'Anthropic ou que vous plongiez dans l'écosystème open source dynamique, l'objectif est le même : faire de l'AI un véritable collègue pour tous.

L'avenir du travail ne consiste pas à remplacer les humains par l'AI — il s'agit de faire travailler les humains et l'AI ensemble, ouvertement et efficacement. C'est la promesse d'Open Cowork.

Sources :